Malgré les apparences, l’I.A. générative (Chat GPT, Midjourney…) ne crée rien, mais réassemble des petits morceaux d’œuvres qu’elle digère pour proposer une réponse aux « prompts » que nous lui soumettons.

C’est parce qu’on leur a montré un nombre considérable d’œuvres littéraires et autres textes (articles…) que Claude, d’Anthropic ou Le Chat, de Mistral, semblent écrire en français naturel. Les programmes ont, à force de les « voir », digéré et intégré le vocabulaire, les structures syntaxiques, etc, qui leur permettent, via des assemblages statistiques, de produire des phrases correctes et qui font sens.

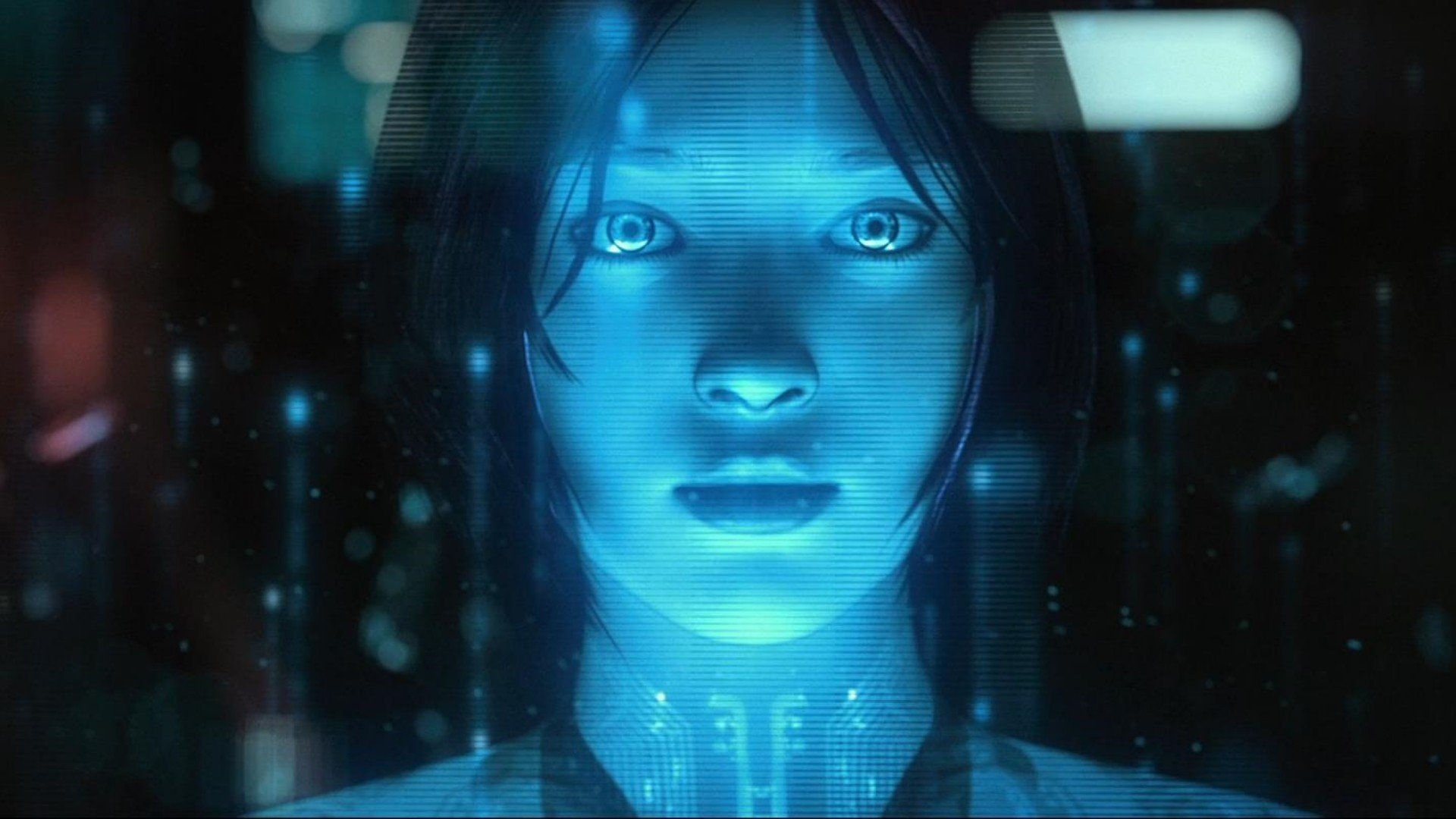

Pour les images, c’est un peu la même chose : nourries par une galaxie d’exemples, les I.A. génératives ont intégré des styles, des façons de faire, pour les mobiliser ensuite à l’aune de la demande de l’utilisateur.

Les « productions » des I.A. génératives sont donc issues de l’exploitation d’œuvres préexistantes, même si les origines précises d’une réponse à un prompt sont souvent très compliquées à identifier. Et justement, cette absence d’évidence permet aux fournisseurs de services d’I.A. génératives de ne pas rendre de comptes. Quand une maison d’édition peu regardante utilise une illustration réalisée par intelligence artificielle générative, c’est le travail d’autres illustrateurs qu’elle exploite, sans les créditer, ni les rémunérer.

C’est cette situation que voudrait corriger une proposition de loi émise par six sénateurs et sénatrices, et qui sera examinée ce mercredi 8 avril. Le principe de cette dernière est que les acteurs de l’I.A. génératives seront dans l’obligation de prouver qu’ils n’utilisent pas de matériel protégé par le droit d’auteur pour l’entraînement de leurs programmes, et dans le cas contraire, ils devront s’acquitter d’une licence visant à rémunérer les créateurs.

Inversion de la charge de la preuve

Cette proposition de loi, si elle a le mérite de prendre à bras le corps certaines inquiétudes actuelles, reste néanmoins très imparfaite. D’abord, elle repose sur l’inversion de la charge de la preuve : en droit, en principe, c’est à l’accusation de prouver la faute. Or, ici, il serait, à l’inverse, demandé aux acteurs de l’I.A. de prouver leur « innocence ». Le Conseil Constitutionnel n’a néanmoins pas retoqué le texte.

L’autre problème, plus large, est celui du droit d’auteur. Il y a fort à parier que les licences qui seraient, suivant cette potentielle future loi, payées par les Open AI, Google ou Mistral, iraient surtout aux industriels et finalement peu aux artistes. Rappelons qu’à l’origine, les premiers principes de droits d’auteurs, les « copyrights », ont été mis en place pour protéger les droits des imprimeurs, et pas du tout ceux des auteurs (d’où le nom…) !

Et puis, c’est une loi qui viendrait aussi « légitimer » le principe du recyclage par I.A. : à ceux qui viendraient critiquer l’exploitation du travail d’autres artistes par les I.A. génératives, les exploitants de ces dernières auront vite fait de répondre qu’ils en ont tout à fait le droit, puisqu’ils paient leur licence. Et tout cela sans, finalement, protéger le travail (dans tous les sens du terme : la production, mais aussi les contrats) des auteurs. Françoise Cadol, à qui on a « emprunté » la voix sans son consentement pour ajouter des doublages générés par I.A. générative dans les dernières compilations Tomb Raider, pourrait-elle encore demander des comptes si des licences sont payées en amont ? Et alors, aurait-elle touché quelque rémunération que ce soit ?

On le voit, s’il faut encadrer les I.A. génératives, leur fonctionnement et leurs usages (on n’évoque même pas ici les problèmes liés au deep fake, par exemple…), à l’ère de ChatGPT, c’est plus généralement le droit d’auteur, et notamment la place de l’auteur qu’il faut revoir. La culture du sampling a introduit l’obligation d’obtenir les autorisations des musiciens originaux. Mais le modèle, s’il est un bon point de départ, n’est pas transposable à l’I.A., dont les sources des productions sont difficilement identifiables. Le législateur devrait ainsi concentrer ses efforts sur la transparence nécessaire des acteurs de l’I.A. s’il veut pouvoir attribuer une « parentalité » à une production, et distribuer de façon juste les revenus d’une potentielle licence.

broccomilie

Intelligence artificielle – Génération slop ?

n1co_m

Sony développe un nouvel outil pour I.A.ssister les joueurs

n1co_m